読み方 : かいきちょくせん

回帰直線【regression line】

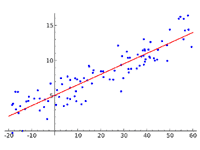

測定値などの分布に基づいて、2つの変数の関係を という一次関数で近似することを線形単回帰という。 を説明変数、 を目的変数と呼び、 の値から未知の を予測・推測できるようになる。

2つの変数の関係について、横軸を説明変数、縦軸を目的変数とする散布図で表したときに、分布の様子を直線で近似したものを回帰直線という。回帰分析で求めた一次関数(回帰式)をグラフ上に描画したものである。先の方程式の は直線の傾きを、 はy切片を表している。

回帰直線は実際のデータを表す各点との距離がなるべく小さくなることが望ましい。この条件を満たすため、一般的には「最小二乗法」という計算法で係数 と の値を決定する。説明変数 において、実測された目的変数は 、回帰式から求めた予測値は となる。

両者の差である を2乗し、各点について合計したものを残差平方和という。これが最小になるときの および を算出すると、 と の平均 と 、標準偏差 と 、相関係数 を用いて、 、 として表すことができる。

(2024.5.20更新)

「回帰直線」の関連用語

他の用語辞典による「回帰直線」の解説 (外部サイト)

資格試験などの「回帰直線」の出題履歴

▼ 基本情報技術者試験

【令3修12 問2】 標本相関係数が -0.9,-0.7,0.7,0.9 のいずれかとなる標本の分布と回帰直線を表したグラフのうち,標本相関係数が-0.9のものはどれか。

【平28修1 問78】 昨年度と今年度の入社試験問題を比較するために,多数の社員に両年度の問題を解答させた。昨年度の問題の得点をx軸に,今年度の問題の得点をy軸にとって,相関係数と回帰直線を求めた。

【平26修1 問76】 昨年度と今年度の入社試験問題を比較するために,多数の社員に両年度の問題を解答させた。昨年度の問題の得点をx軸に,今年度の問題の得点をy軸にとって,相関係数と回帰直線を求めた。

【平23修6 問75】 昨年度と今年度の入社試験問題を比較するために,多数の社員に両年度の問題を解答させた。昨年度の問題の得点をx軸に,今年度の問題の得点をy軸にとって,相関係数と回帰直線を求めた。

【平23修1 問3】 標本相関係数が -0.9,-0.7,0.7,0.9 のいずれかとなる標本の分布と回帰直線を表したグラフのうち,標本相関係数が-0.9のものはどれか。

【平22春 問76】 昨年度と今年度の入社試験問題を比較するために,多数の社員に両年度の問題を解答させた。昨年度の問題の得点をx軸に,今年度の問題の得点をy軸にとって,相関係数と回帰直線を求めた。