読み方 : かがくしゅう

過学習【overtraining】過剰適合

別名 :overfitting/オーバーフィッティング/オーバーフィット

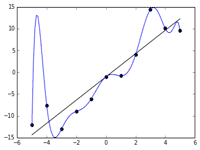

一般に、回帰問題で予測精度を高めるために媒介変数を増やすなどモデルの自由度を高めることが行われるが、学習データの規模に対して詳細すぎるモデルを用意すると、外れ値やノイズ、偏りまで忠実に再現してしまい、本来データが表しているはずの傾向から却って外れてしまう現象が起きる。

このような過学習を起こしたモデルの回帰曲線は学習データのほとんどの点を通る複雑に折れ曲がった形になり、学習データに対しては完全に適合するが、未知のデータに対しては的外れな結果を返し、実地では使い物にならない状態になってしまう。

過学習を緩和する手法は様々なものが提唱されており、可能な場合は学習データを増やしたり、自由度をあえて下げて単純なモデルを使用したりする。学習データを2つに分けて片方で学習、もう片方で精度の検証を行う「交差検証」、モデルが複雑化するとそれを打ち消すようにペナルティを与える「正則化」などの技法が用いられることもある。

(2021.9.16更新)