パーセプトロン【perceptron】

概要

動物の脳は「ニューロン」(neuron)という神経細胞が集まってできている。ネットワーク状に相互に接続されたニューロン群が、外界からの刺激に基づいて相互に電気信号を送り合うことで、記憶や学習、発話、運動制御など様々な情報処理を実現している。

パーセプトロンとは

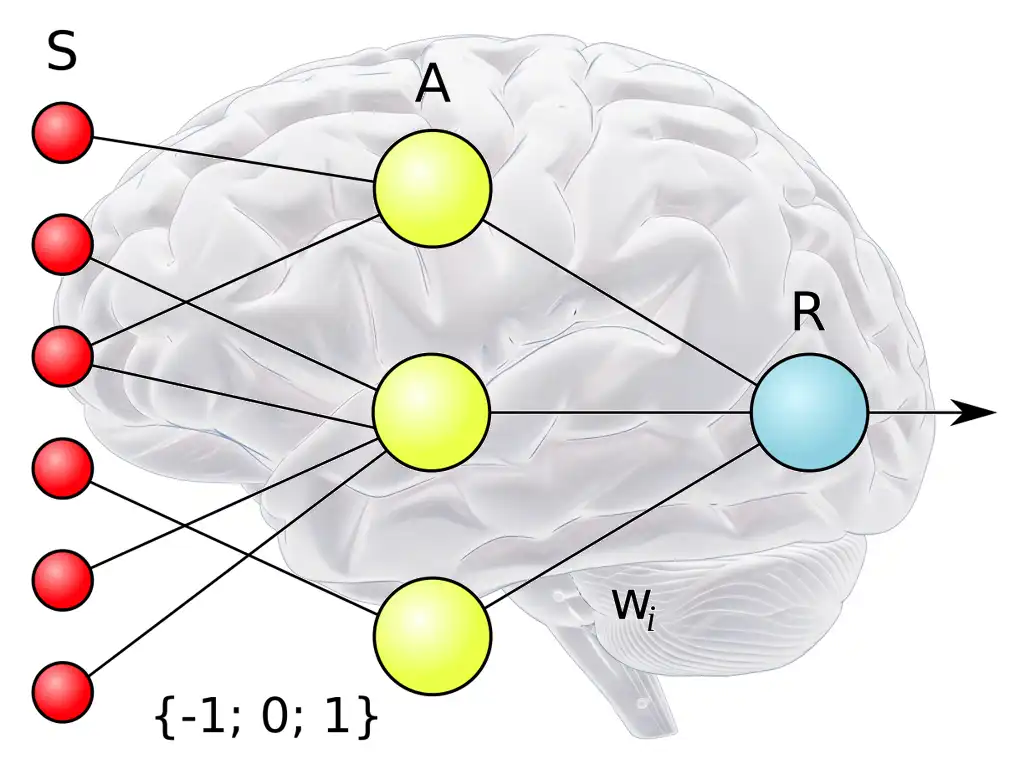

パーセプトロンはこの脳の構造を模したモデルの一つで、ニューロンに相当するノードが層状に並んでいる。大量の学習データを与えると、そこに内在するパターンを学んで内部のパラメータを調整し、回帰問題や分類問題など知的なタスクを解けるようになる。

このコンセプトは1957年にアメリカの情報科学者、フランク・ローゼンプラット(Frank Rosenblatt)が提唱した。当初はこれを専用の機械(ハードウェア)として実装することが構想され、入力層、中間層、出力層の3層の専用コンピュータ「Mark I Perceptron」が1958年に試作された。

パーセプトロンの仕組み

入力層のノードは外部から、それ以外のノードは上位層のノードから電気刺激に相当する値の入力を受け、これを下層のノードに伝達する。ノード間の繋がりにはそれぞれ固有の「重み」が設定されており、下層ノードは上層から重み付き和として値を受け取る。

学習データは入力と対応する出力がペアになっている。ある入力を与えて試しに出力させてみて、正解か否か(あるいは正解からのズレの大きさ)に応じてノード間の重みを調整する。正解に寄与した繋がりの重みはより大きく、誤答の原因となった繋がりの重みは小さく更新する。

パーセプトロンの種類

初期に研究された、入力層と出力層の2層のみからなるシンプルなパーセプトロンを「単純パーセプトロン」(single-layer perceptron)という。汎用のパターン認識を実現する機構として期待されたが、線形分離可能(直線で分けられるような分布)な分類問題しか解けないことが明らかになり、研究は下火となった。

入力層と出力層の間に、入出力に関与せず下層に信号を伝達するだけの「隠れ層」(中間層)を追加した3層以上のパーセプトロンは「多層パーセプトロン」(multi-layer perceptron)という。隠れ層が複数ある、4層以上のパーセプトロンは「ディープニューラルネットワーク」(DNN:Deep Neural Network)と呼ばれる。

多層型の研究は、コンピュータの性能や容量の制約や、効率的な学習方法が見出だせなかったことから停滞していたが、1990年代に誤差逆伝播法(バックプロパゲーション)などの手法が考案され、コンピュータの飛躍的な性能向上もあり、今日ではDNNGが人工知能の主流の実装方式として広まっている。